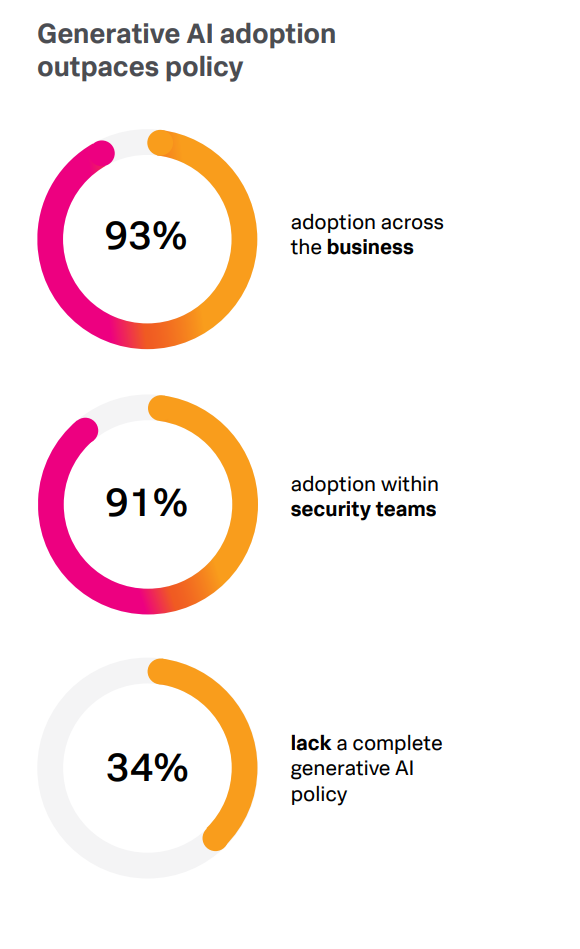

1.650 responsables de seguridad en 9 países (Australia, Francia, Alemania, India, Japón, Nueva Zelanda, Singapur, Reino Unido y Estados Unidos), representantes de sectores clave como aeroespacial, defensa, administración pública, servicios, petróleo y gas, telecomunicaciones, logística y más. Este es el grupo utilizado para elaborar el informe State of Security 2024 de Splunk, del cual se desprenden un par de elementos muy interesantes. En primer lugar, prácticamente todas las organizaciones estudiadas utilizan soluciones de IA generativa de dominio público, como ChatGPT y Copilot, para su trabajo. El problema es que una de cada tres (34%) no ha implementado políticas para regular su uso. Y no es el único: el 65% del grupo aún no comprende completamente las implicaciones de esta tecnología.

State of Security 2024: la GenAI es muy común entre los expertos en seguridad

La IA generativa se ha convertido en una herramienta muy extendida en el mundo de la ciberseguridad. Lo cual es comprensible si lo pensamos detenidamente: los delincuentes informáticos han comenzado a aprovechar esta tecnología para potenciar los ataques y, inevitablemente, la única solución para defenderse era utilizar las mismas herramientas. ¿»Buenos» y «malos» juegan entonces en igualdad de condiciones? «Más o menos«, afirma Gian Marco Pizzuti, Vicepresidente de Área de Splunk. El hecho es que los expertos entrevistados no muestran temores particulares, dado que el uso de GenAI por parte de los delincuentes informáticos no conduce a nuevas tipologías de ataques, sino que potencia los ya existentes. Automatizando actividades rutinarias y ayudando a elaborar correos electrónicos de phishing de manera más efectiva. Según Pizzuti, sin embargo, el impacto en la efectividad de las campañas de phishing ha sido marginal: «Hicimos un ejercicio: tomamos algunos textos de correos electrónicos para simular ataques de tipo BEC (Business Email Compromise). Los hicimos traducir a cuatro idiomas: en tres casos con IA, en dos casos con traductores automáticos tradicionales. Se descubrió que la calidad de la traducción no cambia«.

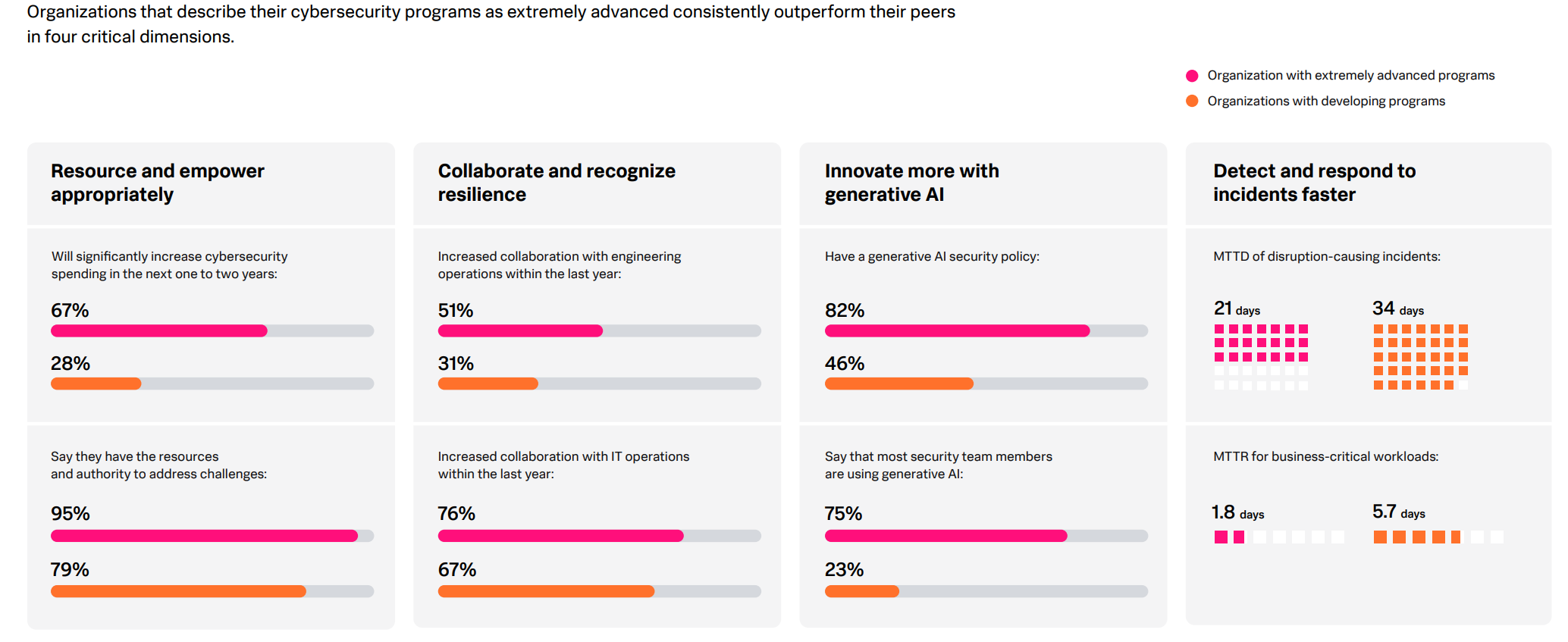

No solo la IA no ha hecho más efectivas las estrategias de ingeniería social, sino que en muchos aspectos se ha convertido en un gran aliado para aquellos que tienen que defender las infraestructuras informáticas de la empresa: el 46% del grupo afirma que gracias a la IA ahora es un poco más fácil defenderse. Aunque es un porcentaje inferior a la mitad del grupo, también hay que tener en cuenta que, en comparación con el informe del año pasado, es un valor en crecimiento, lo que sugiere una tendencia positiva. Como destaca Pizzuti, sin embargo, no es solo una cuestión tecnológica que facilita a los expertos: la colaboración ha aumentado considerablemente, lo que se ha reflejado en la capacidad de respuesta. Tanto que «en los incidentes que causan interrupciones, hay un porcentaje mayor de personas que logran tener un tiempo de detección inferior a 14 días«. Y el tiempo de detección, es decir, el tiempo necesario para descubrir una intrusión desde que ocurrió, es un aspecto clave, ya que cuanto antes se detecte una intrusión, mayores son las posibilidades de limitar posibles daños y evitar que los criminales obtengan más privilegios en los sistemas afectados.

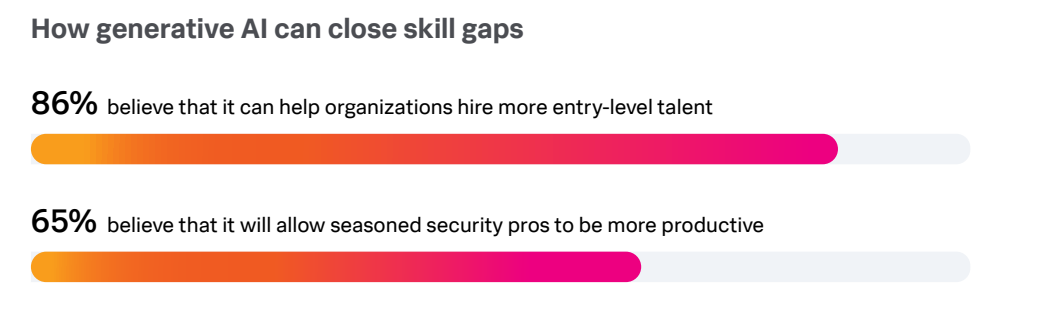

Un dato relevante es que el uso de IA generativa ayudará a cerrar la brecha de habilidades entre los expertos en seguridad senior y los junior: al utilizarla, estos últimos pueden acelerar su proceso de aprendizaje y maduración.

IA en la empresa: todos la utilizan, pocos la regulan

Como se mencionó anteriormente, el uso de IA generativa en el ámbito de la seguridad, incluso en empresas que operan en sectores críticos y altamente regulados, es muy común, superando el 90%. Sin embargo, el hecho de que solo uno de cada tres encuestados afirme que en la empresa existen políticas para su uso es un aspecto que invita a la reflexión. Especialmente si se suma el hecho de que más de la mitad (65%) no comprende completamente las implicaciones de su adopción en la empresa. Según Pizzuti, esto podría representar un problema potencial, ya que si todos están convencidos de que, como sucede actualmente, solo se utiliza para potenciar métodos de ataque ya conocidos, existe el riesgo de que con el tiempo puedan pasar desapercibidos nuevos vectores de ataque.

Un problema que se agrava aún más por otro hecho: las regulaciones, como el GDPR y el EU AI Act, que brindan más control y regulan el uso de la IA, pero también implican mayores esfuerzos para garantizar la conformidad. Y, sobre todo, introducen una responsabilidad personal de los gerentes de ciberseguridad, lo que, según el informe de Splunk, hace que el trabajo sea menos gratificante y más estresante. ¿El resultado? El 70% del grupo admitió haber considerado cambiar de trabajo precisamente por motivos relacionados con el estrés. Además, el 86% ajustará el presupuesto trasladando recursos hacia la conformidad, precisamente para reducir el riesgo de tener que responder personalmente en caso de errores en este aspecto.

Esto no significa que las nuevas normativas sean negativas: traen más responsabilidad y requieren un mayor número de controles, pero según Pizzuti, las regulaciones beneficiarán al mercado, ya que demuestran que la UE está comenzando a dar una respuesta unificada e importante sobre cómo regular la IA, sirviendo de ejemplo para normativas que, al igual que sucedió con el GDPR, luego serán introducidas, con las modificaciones necesarias, también en otros países.